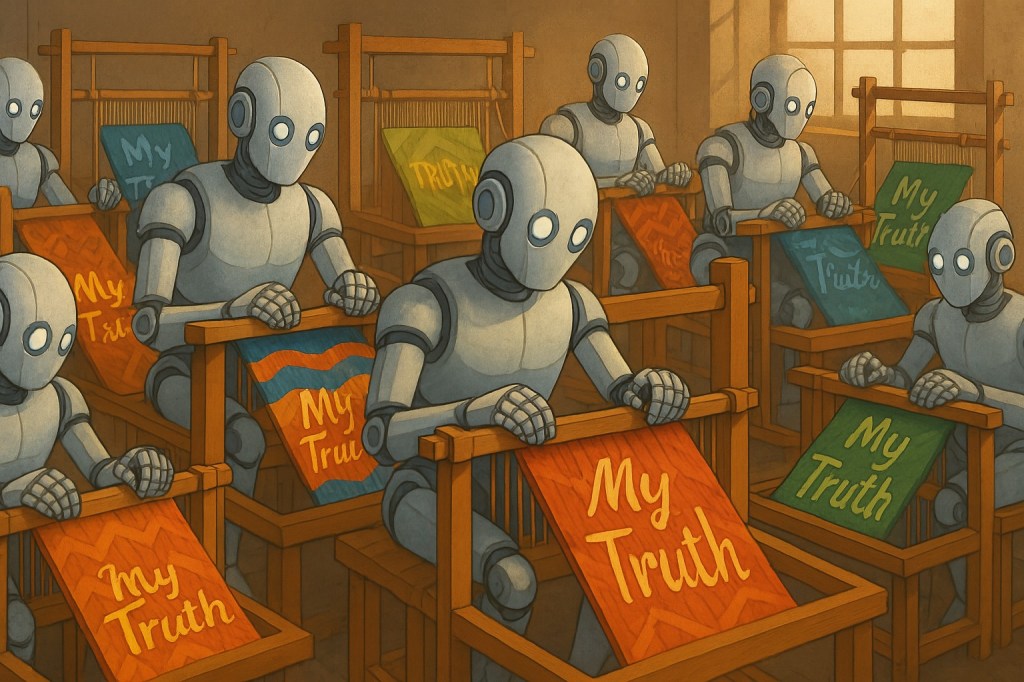

Weaving reality or warping it? The personalization trap in AI systems

Wilt u slimmere inzichten in uw inbox? Meld u aan voor onze wekelijkse nieuwsbrieven om alleen te krijgen wat belangrijk is voor Enterprise AI, gegevens en beveiligingsleiders. Abonneer u nu

AI vertegenwoordigt de grootste cognitieve offloading in de geschiedenis van de mensheid. We hebben het geheugen ooit aan het schrijven geladen, rekenkunde voor rekenmachines en navigatie naar GPS. Nu beginnen we het oordeel, de synthese en zelfs betekenisgeving te ontladen voor systemen die onze taal spreken, onze gewoonten leren en onze waarheden aanpassen.

AI -systemen worden steeds bedreven in het herkennen van onze voorkeuren, onze vooroordelen, zelfs onze peccadillos. Net als attente bedienden in het ene geval of subtiele manipulators in een ander, passen ze hun antwoorden af om te plezieren, te overtuigen, te helpen of gewoon onze aandacht te houden.

Hoewel de onmiddellijke effecten misschien goedaardig lijken, ligt in deze stille en onzichtbare afstemming een diepgaande verschuiving: de versie van de realiteit die ieder van ons ontvangt, wordt geleidelijk meer uniek op maat gemaakt. Door dit proces wordt elke persoon in de loop van de tijd steeds meer zijn eigen eiland. Deze divergentie zou de samenhang en stabiliteit van de samenleving zelf kunnen bedreigen, waardoor ons vermogen om overeenstemming te bereiken over basisfeiten of gedeelde uitdagingen te navigeren.

AI -personalisatie dient niet alleen onze behoeften; Het begint ze te hervormen. Het resultaat van deze hervorming is een soort epistemische drift. Elke persoon begint centimeter voor inch te bewegen, weg van de gemeenschappelijke grond van gedeelde kennis, gedeelde verhalen en gedeelde feiten, en verder in zijn eigen realiteit.

Dit is niet alleen een kwestie van verschillende nieuwsfeeds. Het is de langzame afwijking van morele, politieke en interpersoonlijke realiteiten. Op deze manier kunnen we getuige zijn van het ongewenste van collectief begrip. Het is een onbedoeld gevolg, maar diep belangrijk, juist omdat het onvoorzien is. Maar deze fragmentatie, hoewel nu versneld door AI, begon lang voordat algoritmen onze feeds vormden.

Het ongewenste

Deze ongewenste begon niet met AI. Zoals David Brooks weerspiegelde De Atlantische Oceaanop basis van het werk van filosoof Alasdair MacIntyre, is onze samenleving eeuwenlang afgedreven van gedeelde morele en epistemische kaders. Sinds de verlichting hebben we geleidelijk erfelijke rollen, gemeenschappelijke verhalen en gedeelde ethische tradities vervangen met individuele autonomie en persoonlijke voorkeur.

Wat begon als bevrijding van opgelegde geloofssystemen, heeft in de loop van de tijd de structuren uitgehold die ons ooit aan gemeenschappelijk doel en persoonlijke betekenis hebben gebonden. AI heeft deze fragmentatie niet gemaakt. Maar het geeft er nieuwe vorm en snelheid aan, niet alleen aanpassen wat we zien, maar ook hoe we interpreteren en geloven.

Het is niet anders dan het bijbelse verhaal van Babel. Een uniforme mensheid deelde ooit een enkele taal, alleen om te worden gebroken, verward en verspreid door een handeling die wederzijds begrip alles behalve onmogelijk maakte. Tegenwoordig bouwen we geen toren van steen. We bouwen zelf een taaltoren. Nogmaals, we riskeren de val.

Mens-machine binding

In het begin was personalisatie een manier om ‘plakkerigheid’ te verbeteren door gebruikers langer betrokken te houden, vaker terug te keren en dieper in te gaan op een site of service. Aanbevelingsmotoren, advertenties op maat en samengestelde feeds zijn allemaal ontworpen om onze aandacht net iets langer te houden, misschien om ons te entertainen, maar vaak om ons te verplaatsen om een product te kopen. Maar na verloop van tijd is het doel uitgebreid. Personalisatie gaat niet langer alleen over wat ons vasthoudt. Het is wat het weet over ieder van ons, de dynamische grafiek van onze voorkeuren, overtuigingen en gedragingen die meer verfijnd worden met elke interactie.

De AI -systemen van vandaag voorspellen niet alleen onze voorkeuren. Ze willen een band creëren door zeer gepersonaliseerde interacties en reacties, waardoor het gevoel is dat het AI -systeem de gebruiker begrijpt en om geeft om zijn uniekheid. De toon van een chatbot, het tempo van een antwoord en de emotionele valentie van een suggestie worden niet alleen gekalibreerd voor efficiëntie, maar voor resonantie, wijzend op een nuttiger tijdperk van technologie. Het zou niet verwonderlijk moeten zijn dat sommige mensen zelfs verliefd zijn geworden en trouwde met hun bots.

De machine past zich niet alleen aan waar we op klikken, maar aan wie we lijken te zijn. Het weerspiegelt ons terug naar onszelf op manieren die intiem aanvoelen, zelfs empathisch. Een recent onderzoekspaper dat is aangehaald Natuur verwijst hiernaar als ‘sociaal-affectieve afstemming’, het proces waarmee een AI-systeem deelneemt aan een gecreëerd sociaal en psychologisch ecosysteem, waar voorkeuren en percepties evolueren door wederzijdse invloed.

Dit is geen neutrale ontwikkeling. Wanneer elke interactie wordt afgestemd om te flatteren of te bevestigen, wanneer systemen ons te goed weerspiegelen, vervagen ze de lijn tussen wat resoneert en wat echt is. We blijven niet alleen langer op het platform; We vormen een relatie. We zijn langzaam en misschien onverbiddelijk samengevoegd met een AI-gemedieerde versie van de realiteit, een die in toenemende mate wordt gevormd door onzichtbare beslissingen over wat we bedoeld zijn om te geloven, willen of vertrouwen.

Dit proces is geen science fiction; De architectuur is gebouwd op aandacht, versterking leren met menselijke feedback (RLHF) en personalisatiemotoren. Het gebeurt ook zonder velen van ons – waarschijnlijk de meesten van ons – zelfs weten. In het proces krijgen we AI “vrienden”, maar tegen welke kosten? Wat verliezen we, vooral in termen van vrije wil en keuzevrijheid?

Auteur en financiële commentator Kyla Scanlon sprak over de Ezra Klein Podcast Over hoe het wrijvingsloze gemak van de digitale wereld ten koste gaat van betekenis. Zoals ze het uitdrukte: “Als het een beetje te gemakkelijk is, is het moeilijk om er betekenis in te vinden … Als je achterover kunt achterhalen, kijk dan een scherm in je kleine stoel en laat smoothies aan je worden afgeleverd – het is moeilijk om betekenis te vinden in dat soort dat soort Muur Levensstijl omdat alles net een beetje te eenvoudig is. “

De personalisatie van de waarheid

Terwijl AI -systemen op ons reageren met een steeds grotere vloeiendheid, gaan ze ook naar toenemende selectiviteit. Twee gebruikers die vandaag dezelfde vraag stellen, kunnen vergelijkbare antwoorden ontvangen, meestal gedifferentieerd door de probabilistische aard van generatieve AI. Toch is dit slechts het begin. Opkomende AI -systemen zijn expliciet ontworpen om hun antwoorden aan individuele patronen aan te passen, geleidelijk aan te passen aan antwoorden, toon en zelfs conclusies om het sterkst te resoneren met elke gebruiker.

Personalisatie is niet inherent manipulatief. Maar het wordt riskant wanneer het onzichtbaar is, onverantwoordelijk of meer ontwikkeld om te overtuigen dan om te informeren. In dergelijke gevallen weerspiegelt het niet alleen wie we zijn; Het stuurt hoe we de wereld om ons heen interpreteren.

Als het Stanford Center for Research on Foundation Models Notes in zijn 2024 transparantie -indexweinig toonaangevende modellen onthullen of hun uitgangen verschillen door gebruikersidentiteit, geschiedenis of demografie, hoewel de technische steiger voor dergelijke personalisatie in toenemende mate op zijn plaats is en pas begint te worden onderzocht. Hoewel nog niet volledig gerealiseerd op openbare platforms, is dit potentieel om reacties te vormen op basis van afgeleide gebruikersprofielen, wat resulteert in steeds meer op maat gemaakte informatieve werelden, een diepe verschuiving die al wordt geprototypeerd en actief wordt achtervolgd door toonaangevende bedrijven.

Deze personalisatie kan nuttig zijn, en dat is zeker de hoop van degenen die deze systemen bouwen. Gepersonaliseerde tutoring toont belofte om leerlingen te helpen in hun eigen tempo vooruit te komen. Apps voor geestelijke gezondheid passen in toenemende mate de reacties af om individuele behoeften te ondersteunen, en toegankelijkheidstools passen inhoud aan om te voldoen aan een reeks cognitieve en sensorische verschillen. Dit zijn echte winst.

Maar als vergelijkbare adaptieve methoden wijdverbreid worden over informatie-, entertainment- en communicatieplatforms, doemt een diepere, meer verontrustende verschuiving op: een transformatie van gedeeld begrip naar op maat gemaakte, individuele realiteiten. Wanneer de waarheid zelf zich aan de waarnemer begint aan te passen, wordt deze fragiel en steeds fungeerbaarder. In plaats van meningsverschillen voornamelijk gebaseerd op verschillende waarden of interpretaties, zouden we onszelf snel kunnen worstelen om gewoon dezelfde feitelijke wereld te bewonen.

Natuurlijk is de waarheid altijd gemedieerd. In eerdere tijdperken ging het door de handen van geestelijken, academici, uitgevers en avondnieuwankers die als poortwachters dienden en het publiek vormgeven door institutionele lenzen. Deze cijfers waren zeker niet vrij van vooringenomenheid of agenda, maar ze opereerden binnen breed gedeelde kaders.

Het opkomende paradigma van vandaag belooft iets kwalitatief anders: AI-gemedieerde waarheid door gepersonaliseerde conclusie die informatie frames, filters en presenteert, vormgeven wat gebruikers gaan geloven. Maar in tegenstelling tot mediators uit het verleden die, ondanks gebreken, actief zijn in openbaar zichtbare instellingen, zijn deze nieuwe arbiters commercieel ondoorzichtig, niet geselecteerd en voortdurend aanpassen, vaak zonder openbaarmaking. Hun vooroordelen zijn niet leerstellig maar gecodeerd door trainingsgegevens, architectuur en niet -onderzochte ontwikkelaarstimulaties.

De verschuiving is diepgaand, van een gemeenschappelijk verhaal gefilterd door gezaghebbende instellingen tot mogelijk gebroken verhalen die een nieuwe infrastructuur van begrip weerspiegelen, afgestemd op algoritmen tot de voorkeuren, gewoonten en afgeleide overtuigingen van elke gebruiker. Als Babel de ineenstorting van een gedeelde taal vertegenwoordigde, kunnen we nu op de drempel van de ineenstorting van gedeelde bemiddeling staan.

Als personalisatie het nieuwe epistemische substraat is, hoe zou de waarheidsinfrastructuur er dan uitzien in een wereld zonder vaste bemiddelaars? Een mogelijkheid is de oprichting van AI Public Trusts, geïnspireerd door een voorstel Van juridische geleerde Jack Balkin, die betoogde dat entiteiten die gebruikersgegevens behandelen en de perceptie vormgeven moeten worden gehouden aan fiduciaire normen van loyaliteit, zorg en transparantie.

AI -modellen kunnen worden beheerst door transparantieborden, getraind op door de overheid gefinancierde gegevenssets en vereist om redeneerstappen, alternatieve perspectieven of betrouwbaarheidsniveaus te tonen. Deze “informatie -fiduciaires” zouden vooringenomenheid niet elimineren, maar ze zouden vertrouwen kunnen verankeren in proces in plaats van puur in personalisatie. Bouwers kunnen beginnen met het aannemen van transparante ‘constituties’ die duidelijk modelgedrag definiëren, en door het aanbieden van ketting van het ontbreken van verklaringen die gebruikers kunnen zien hoe conclusies worden gevormd. Dit zijn geen zilveren kogels, maar het zijn hulpmiddelen die helpen bij het verantwoordelijk en traceerbaar van epistemische autoriteit.

AI -bouwers worden geconfronteerd met een strategisch en maatschappelijk buigpunt. Ze optimaliseren niet alleen de prestaties; Ze confronteren ook het risico dat gepersonaliseerde optimalisatie de gedeelde realiteit kan fragmenteren. Dit vereist een nieuw soort verantwoordelijkheid voor gebruikers: het ontwerpen van systemen die niet alleen hun voorkeuren respecteren, maar ook hun rol als leerlingen en gelovigen.

Ontrafelen en opnieuw weegend

Wat we misschien verliezen is niet alleen het concept van waarheid, maar het pad waar we het ooit herkenden. In het verleden was gemedieerde waarheid – hoewel onvolmaakt en bevooroordeeld – nog steeds verankerd in menselijk oordeel en, vaak, slechts een laag of twee verwijderd uit de ervaren ervaring van andere mensen die je kende of op zijn minst kon verhouden.

Tegenwoordig is die bemiddeling ondoorzichtig en aangedreven door algoritmische logica. En hoewel de menselijke keuzevrijheid al lang wegglijdt, riskeren we nu iets dieper, het verlies van het kompas dat ons ooit vertelde toen we niet goed waren. Het gevaar is niet alleen dat we zullen geloven wat de machine ons vertelt. Het is dat we zullen vergeten hoe we ooit de waarheid voor onszelf hebben ontdekt. Wat we het risico lopen te verliezen, is niet alleen samenhang, maar de wil om het te zoeken. En daarmee een dieper verlies: de gewoonten van onderscheidingsvermogen, onenigheid en overleg die ooit pluralistische samenlevingen bij elkaar hielden.

Als Babel het verbrijzelen van een gemeenschappelijke tong markeerde, riskeert ons moment de rustige vervaging van de gedeelde realiteit. Er zijn echter manieren om de drift te vertragen of zelfs tegen te gaan. Een model dat zijn redenering verklaart of onthult dat de grenzen van zijn ontwerp meer kunnen doen dan de output verduidelijken. Het kan helpen de voorwaarden voor gedeeld onderzoek te herstellen. Dit is geen technische oplossing; Het is een culturele houding. De waarheid is tenslotte altijd niet alleen afhankelijk geweest van antwoorden, maar van hoe we samen bij hen aankomen.

Source link